Texto em que o autor apresenta e defende suas ideias e opiniões, a partir da interpretação de fatos e dados.

Decisões da Suprema Corte dos EUA sobre redes sociais afetam o Brasil?

Receba os novos posts desta coluna no seu e-mail

A Suprema Corte dos Estados Unidos decidiu dois casos sobre o papel das plataformas digitais na disseminação de conteúdo danoso. Em questão estava se a divulgação de conteúdos do grupo terrorista Estado Islâmico (ISIS) em sites como YouTube e Twitter poderia gerar a responsabilização dessas empresas por atentados cometidos por indivíduos ligados ao grupo.

Em ambos os casos os familiares de vítimas de atentados terroristas, ocorridos na França e na Turquia, respectivamente, alegavam que a exibição de conteúdos do ISIS nas plataformas digitais fazia com que as empresas pudessem ser enquadradas na legislação que responsabiliza aqueles que auxiliam e apoiam atos terroristas.

Havia grande expectativa sobre o desfecho desses casos, em especial porque nos Estados Unidos existe uma legislação que confere imunidade às plataformas digitais pelos conteúdos postados por seus usuários.

A seção 230 da Lei da Decência das Comunicações, de 1996, impede que provedores sejam responsabilizados tanto pelos conteúdos publicados por terceiros em seus ambientes online, como por seus atos de moderação de conteúdo, removendo qualquer publicação que pareça lesiva.

Será que a Suprema Corte iria afastar essa imunidade e responsabilizar as plataformas?

Teríamos enfim um precedente judicial que analisasse o uso de algoritmos e como eles podem levar à radicalização de usuários?

Nada disso aconteceu.

Dado o momento de atenção global sobre o tema da regulação das plataformas digitais, muita gente ficou frustrada com as decisões da Suprema Corte, que acabaram não responsabilizando as plataformas nos casos em questão.

Não faltaram comentários no sentido de que o tribunal americano optou por proteger empresas americanas. Ou que nem tão cedo temas sobre internet voltariam a ser apreciados pela Suprema Corte.

Calma lá.

É preciso entender, em primeiro lugar, como os dois casos representavam, desde a largada, hipóteses de responsabilização muito frágeis.

Em seguida vale conhecer um pouco mais do que decidiu a Suprema Corte e se perguntar se é mesmo verdade que a porta está fechada para novos temas sobre internet naquele tribunal.

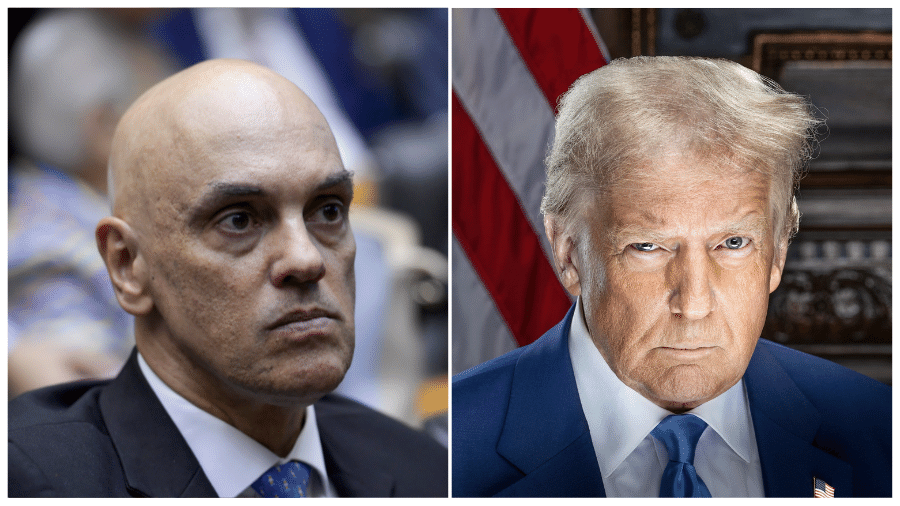

Por fim, como o Supremo Tribunal Federal, aqui no Brasil, está se preparando para julgar dois casos sobre o tema da responsabilidade de plataformas do lado de cá, vamos entender se as decisões americanas exercem alguma influência no debate brasileiro.

Tudo em todo lugar ao mesmo tempo

Os casos que chegaram para julgamento na Suprema Corte dos Estados Unidos são muito peculiares. Eles procuravam responsabilizar as plataformas digitais por danos causados fora de seus ambientes online.

De modo geral, os autores argumentaram que, ao deixar conteúdos do ISIS no ar, YouTube, Twitter e demais redes sociais poderiam ser responsabilizadas pelos danos decorrentes de atentados cometidos por indivíduos recrutados e radicalizados a partir desses materiais.

Mais especificamente, à luz da legislação antiterrorismo norte-americana, a questão era se as plataformas poderiam ser enquadradas como tendo auxiliado e apoiado esses atos criminosos.

Em termos de responsabilidade civil, o nexo causal entre a conduta das empresas e o resultado danoso ficou longe de estar provado.

No caso do atentado na Turquia, por exemplo, não houve nem mesmo comprovação de que o autor do ataque fosse usuário das plataformas em questão.

E mesmo se fosse, será que esse fator seria suficiente para atrair a responsabilidade das empresas? Quantos outros fatores não poderiam estar mais direta e imediatamente relacionados ao incidente e que poderiam quebrar a cadeia de causalidade, elemento necessário para a responsabilização?

Para quem trabalha com responsabilidade civil, essa é uma questão bastante comum: em que momento se traça uma linha de corte no nexo de causalidade, fazendo com que apenas condutas direta e imediatamente ligadas ao resultado danoso possam gerar responsabilização?

Se isso não fosse feito, quem vende um carro poderia ser responsabilizado por qualquer acidente causado pelo seu comprador no futuro. Ou os provedores de acesso poderiam ser responsabilizados por um crime virtual apenas por terem conectado o criminoso na rede.

Por isso sempre me pareceu muito difícil que a Suprema Corte fosse responsabilizar as empresas nesses dois casos.

O sistema jurídico nos Estados Unidos está alicerçado no poder dos precedentes judiciais. Toda mudança de orientação por parte da corte superior gera um efeito em cascata e pode criar balizas que transcendem os fatos do julgamento em questão.

Imagine o potencial de confusão que o tribunal traria ao mundo se decidisse que um nexo causal tão distante como o presente nesses casos pudesse gerar a responsabilização das empresas.

O multiverso de hipóteses que se abriria com esse alargamento da causalidade seria de fazer inveja aos filmes da Marvel, criando responsabilidades por tudo em todo lugar ao mesmo tempo.

O que significa auxiliar e apoiar atos terroristas?

As decisões da Suprema Corte acabaram não entrando muito no debate sobre o regime de imunidades concedido às plataformas nos Estados Unidos. O tribunal focou no argumento trazido pelas partes no sentido de que os provedores poderiam ser enquadrados na legislação antiterrorismo por auxiliar e apoiar esses atos.

Para isso a Corte interpretou os termos da Lei sobre Justiça Contra os Apoiadores de Terrorismo (Justice Against Sponsors of Terrorism - JASTA), de 2016. A lei prevê a responsabilidade de quem "auxilia e apoia, providenciando conscientemente assistência substancial, ou conspirando com a pessoa que comete ato de terrorismo internacional."

O termo "auxilia e apoia" é uma construção centenária do sistema de precedentes norte-americano. A interpretação mais recorrente do que significa auxiliar e apoiar um ato ilícito decorre dos parâmetros traçados pelo chamado caso Halberstam. A própria lei de 2016, ao tratar de auxílio e apoio a atos terroristas faz menção aos parâmetros desse caso.

No caso Halbertsam, a Corte de Apelações do Distrito de Columbia decidiu que a namorada de um homem que invadia casas para roubar objetos de valor poderia ser corresponsabilizada por um homicídio cometido pelo namorado em uma das suas invasões de domicílio. Pesou contra a mesma não apenas o conhecimento sobre a natureza das atividades do namorado, como também o apoio prestado através da venda dos produtos do crime.

O julgamento desse caso criou um teste para saber se o réu pode ser responsabilizado por auxiliar e apoiar um ato ilícito.

Para tanto:

- Deve haver um ato ilícito causando uma lesão realizada pela pessoa a quem o réu prestou auxílio;

- Quando a assistência é prestada, o réu deve ser "geralmente ciente de seu papel como parte uma atividade ilegal ou ilícita"; e

- O réu deve ter "consciente e substancialmente assistido a violação principal".

A Suprema Corte entendeu que os provedores não atingiam todos os elementos para que pudessem ser enquadrados como tendo auxiliado e apoiado os atentados terroristas.

Chama atenção que o tribunal, por diversas vezes, menciona que responsabilizar as plataformas pelos danos causados seria como responsabilizar as empresas de telefonia pelo conteúdo das ligações.

Segundo a decisão da Suprema Corte no caso Twitter x Taamneh:

A mera criação dessas plataformas não gera responsabilização. Para ficar claro: pode ser que atores mal-intencionados, como o ISIS, usem plataformas como as dos réus para fins ilegais —às vezes até terríveis. Mas o mesmo pode ser dito dos telefones celulares, e-mails ou da internet como um todo. Ainda assim, geralmente nós não pensamos que as empresas de telefonia móvel ou de internet possam ser culpadas meramente por oferecer esse serviço ao público. E nem mesmo pensamos que usualmente esses provedores podem ser descritos como auxiliando ou apoiando, por exemplo, a oferta de drogas combinadas pelo celular, mesmo se os seus serviços de videochamada facilitem esses arranjos.

Algoritmos e a postura dos provedores

O tribunal também afirmou que os algoritmos de recomendação das empresas não favoreceram especialmente conteúdos do Estado Islâmico, tendo exibido esses materiais de acordo com regras e parâmetros pré-estabelecidos. Ou seja, os algoritmos funcionaram da mesma forma que operariam com qualquer outro tipo de conteúdo.

Na decisão do caso Twitter x Taamneh, a Suprema Corte rebateu da seguinte forma o argumento de que algoritmos de recomendação poderiam ser enquadrados como forma de auxílio e apoio aos atos terroristas:

Os autores alegam que os algoritmos de recomendação dos réus vão além do apoio passivo e prestam assistência substancial e ativa. Nós discordamos. Nas palavras dos autores, as suas alegações se baseiam no fato de que os réus provêm a infraestrutura que proporciona apoio material ao ISIS. Visto da forma correta, os algoritmos de recomendação dos réus são meramente parte dessa infraestrutura. Todo conteúdo em suas plataformas é filtrado por esses algoritmos, que distribuem as publicações a partir de informações e inputs disponibilizados pelos próprios usuários e pelos conteúdos em si.

Sendo assim, concluiu a Suprema Corte que:

Conforme apresentado aqui, os algoritmos parecem agnósticos sobre a natureza do conteúdo, pareando cada material (incluindo aquele do ISIS) com qualquer usuário mais inclinado a ver esse conteúdo. O fato de que esses algoritmos conectaram conteúdos do ISIS com o perfil de certos usuários não converte a assistência passiva dos réus em apoio ativo. Uma vez que a plataforma e as ferramentas de alocação algorítmica começaram a operar, os réus alegadamente apenas deram um passo atrás e assistiram; eles não tomaram qualquer atitude adicional com relação ao ISIS.

Esse ponto é especialmente importante.

A decisão da Suprema Corte dos Estados Unidos não se debruçou sobre o regime geral de responsabilidade das plataformas, mas sim sobre o que poderia ou não ser enquadrado como "auxiliar e apoiar" atos terroristas. Nesse particular, os contornos oferecidos pelo caso Halbertsam e os precedentes dos tribunais moldaram os rumos do julgamento.

A Corte estava mais preocupada em entender se houve, por parte das empresas, favorecimento ao Estado Islâmico ou alguma conexão direta com os atentados.

Nesse sentido, a postura passiva das plataformas, falhando em atuar para remover conteúdos ilícitos como os postados pelo ISIS, somado à eventual moderação dessas postagens, desarmaram as alegações de que haveria auxílio ou apoio por parte das empresas.

Nos quadrantes do que foi alegado, era preciso mostrar uma postura ativa de suporte, o que não aconteceu. A corte entendeu que a falha em moderar contas e conteúdos do ISIS não se encaixava no conceito de auxiliar e apoiar atos terroristas.

Segundo a Corte:

Aplicando o guia fornecido pela common law e pelo caso Halberstam, o nexo entre os réus e o ataque está muito distante. Como alegado pelos demandantes, os réus projetaram plataformas virtuais e conscientemente falharam em fazer 'o suficiente' para remover usuários afiliados ao ISIS e conteúdo de suas plataformas. No entanto, os demandantes não conseguiram alegar que os réus forneceram intencionalmente qualquer ajuda substancial ao ataque ou que de outra forma participaram conscientemente dele —muito menos que de os réus ajudaram o ISIS de forma tão difundida e sistemática a ponto de se tornar responsáveis por todos os ataques do ISIS.

Portas fechadas na Suprema Corte?

Como visto, os casos que chegaram para decisão da Suprema Corte dos Estados Unidos eram muito específicos e repletos de fragilidades.

Não apenas o nexo causal entre os atentados e o comportamento dos provedores era muito distante, como também as peculiaridades envolvidas fizeram com que a discussão ficasse restrita aos confins da legislação antiterror ao invés de propiciar qualquer debate mais amplo sobre o regime de responsabilidade das plataformas digitais.

As portas parecem então estar fechadas para esse debate específico na Suprema Corte. A alegação de que o uso de algoritmos de recomendação significa apoio a atos terroristas e gera responsabilização não volta tão cedo. Lembrando que nos Estados Unidos a Suprema Corte escolhe um reduzido número de casos para apreciar a cada período.

Isso não quer dizer, todavia, que a porta está fechada na Suprema Corte para o debate sobre temas envolvendo internet. Existem dois casos pendentes de julgamento sobre a edição de leis estaduais que restringem as atividades de moderação de conteúdo por parte das redes sociais.

Além disso, sobre o tema da responsabilidade de plataformas, parece bastante relevante que a ministra Ketanji Brown Jackson, em voto separado, tenha afirmado que o assunto poderia voltar, em outros quadrantes, para decisão na Suprema Corte.

Segundo a ministra:

A visão do tribunal sobre os fatos —incluindo suas caracterizações das plataformas de mídia social e algoritmos— baseia-se nas alegações específicas dessas reclamações. Outros casos que apresentam alegações diferentes e registros diferentes podem levar a conclusões diferentes.

O que o STF vai decidir

O Supremo Tribunal Federal já sinalizou que deve julgar dois casos envolvendo o regime de responsabilidade de redes sociais.

Um deles olha para o tema antes da edição do Marco Civil da Internet e trata da não remoção de uma comunidade no Orkut que ofendia uma professora. Sim, do Orkut.

O outro caso questiona a constitucionalidade do artigo 19 do Marco Civil da Internet, que estabelece que provedores de aplicações (como redes sociais) apenas podem ser responsabilizados civilmente caso não cumpram com a ordem judicial que determina a remoção de conteúdo ilícito.

Não é difícil perceber como as questões que foram apresentadas ao Supremo Tribunal Federal pouco se parecem com aquelas que levaram às decisões na Suprema Corte norte-americana.

O debate nos Estados Unidos ficou preso sobre os contornos do que seria auxiliar e apoiar atos terroristas. Por lá, o comportamento passivo das plataformas acabou até auxiliando a formação do entendimento de que não houve por parte das empresas qualquer suporte à organização terrorista.

Do lado de cá os polos são invertidos.

O debate sobre o artigo 19 questiona se o desenho do regime de responsabilidade não deveria ser atualizado para criar estímulos à moderação de conteúdo.

A bem da verdade, essa atualização deveria vir do Congresso Nacional, mas as tribulações na votação do PL2630/20 (que ainda carece de alguns aperfeiçoamentos na sua redação) acabam ampliando a oportunidade do julgamento no STF vir a traçar linhas gerais sobre a responsabilização dos provedores.

Se por um lado não parece que o regime do artigo 19 do Marco Civil da Internet seja inconstitucional, é também perceptível que passados oito anos da aprovação dessa lei, as regras sobre o funcionamento das redes no Brasil precisam passar por alguma forma de atualização, justamente de olho no aumento da transparência e na criação de incentivos para que a moderação de conteúdo seja informativa e coerente.

Por isso parece difícil conectar o resultado que saiu da Suprema Corte nos Estados Unidos com o destino das decisões que o Supremo tem pela frente.

Se ambas as cortes foram chamadas a se posicionar sobre o tema da responsabilidade das plataformas digitais, as especificidades dos casos nos EUA acabaram limitando os contornos do debate.

Por isso, é pouco provável que as conclusões lá obtidas possam influenciar de modo importante a discussão por aqui.

O debate sobre a responsabilidade de plataformas no Brasil ganhou contornos muito próprios.

Os acontecimentos recentes —como a violência de 8 de janeiro, a ameaça de ataques em escolas, além das idas e vindas do PL 2630/20— tomaram de assalto o momento de decisão de ações judiciais que chegaram no STF muito antes do nosso contexto se tornar tão complicado.

Fica a sensação de que quanto mais o Supremo demora em desatar esse nó, mais elementos vão se aglutinar na discussão. A ascensão da inteligência artificial generativa, com aplicações como o ChatGPT, não nos deixa mentir.

O Supremo não deveria ter que decidir sobre os rumos da regulação sobre internet no Brasil.

Os dois casos que estão prestes a serem julgados tratam do regime de responsabilidade a ser aplicado às situações ocorridas antes de 2014 (caso do Orkut) e a constitucionalidade do artigo 19 do Marco Civil.

Mas quanto mais o tempo passa, diferente do que ocorreu nos Estados Unidos, mais uma fala do STF se parece com um vaticínio geral sobre o estado das coisas nas redes.

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.