Texto em que o autor apresenta e defende suas ideias e opiniões, a partir da interpretação de fatos e dados.

É só imagem 3D? Não, IA do Google pode aprender a criar o metaverso

Receba os novos posts desta coluna no seu e-mail

Algumas semanas atrás pesquisadores do Google publicaram um paper chamado DreamFusion, apresentando uma nova tecnologia capaz de traduzir textos em imagens 3D.

O princípio é muito parecido com o de sistemas como Dall-E e Stable Diffusion que transformam um "prompt" descritivo de texto em uma imagem e que já apresentamos aqui na coluna.

A diferença é que, ao invés de gerar imagens bidimensionais —fotos, desenhos, pinturas— o DreamFusion é capaz de gerar modelos 3D com textura.

A técnica é engenhosa. Normalmente, a abordagem que se usa nesse caso é treinar o computador com milhões de pares de "modelo 3D e descrição", ou seja, você adiciona na memória do computador um modelo de casa tridimensional e a palavra "casa", depois um modelo de carro, de cavalo e assim sucessivamente. Com um volume suficientemente grande de dados e o uso de redes neurais, a máquina começa a aprender "sozinha" e consegue fazer junções e derivações de conceitos.

Os engenheiros do Google economizaram esse passo e utilizaram uma base já existente de imagens 2D e texto e, ao invés de aplicar o resultado em uma superfície 2D, eles misturaram com uma outra tecnologia chamada NeRF (Neural Radiance Field) para gerar esses modelos tridimensionais.

No site do projeto, você encontra uma enorme galeria de modelos gerados que vão de dinossauros até astronautas.

Nesse ponto, talvez você esteja se perguntando: "qual a utilidade disso?"

Bom, existem, claro, uma série de aplicações em campos específicos, mas para esses colunistas uma das mais interessantes é justamente na construção potencial dos metaversos.

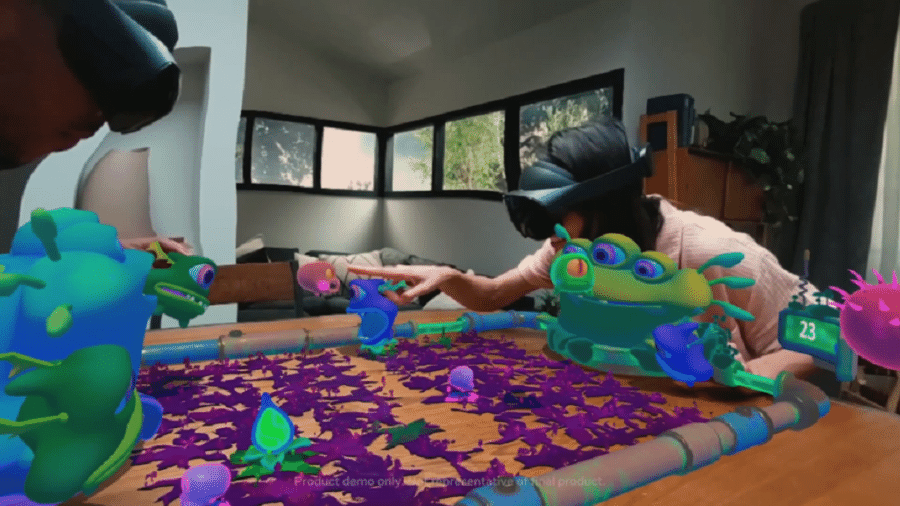

Imagine você poder descrever uma cena, apenas com texto e ter um sistema que gera automaticamente uma sala, uma paisagem e até mesmo um mundo já tridimensional e totalmente compatível com os óculos imersivos?

Ou ser possível, de dentro do seu Oculus, invocar com comando de voz um modelo articulado de qualquer objeto que você for capaz de nomear e descrever, podendo gerar centenas de variações, sem nenhum trabalho humano envolvido?

Para além dos ambientes do Oculus, diversos metaversos como Roblox e Fortnite podem se beneficiar de uma tecnologia como essa. E até mesmo impressoras 3D.

A tecnologia, claro, ainda está em um estágio incipiente. Embora o sistema já consiga gerar os tais modelos 3D, eles são estanques e desarticulados, mais estátuas do que reais modelos.

Mas não faz muito tempo que começamos a experimentar todas essas ferramentas e o progresso acontece paper a paper.

Para quem quiser entender um pouco melhor a tecnologia, recomendamos bastante acompanhar o canal de Youtube "Two Minutes Paper" que explica esse e diversos outros papers com bastante entusiasmo.

Esta em inglês, mas uma outra inteligência artificial já te permite traduzir automaticamente qualquer legenda do Youtube, então vá em frente!

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.