Caça ao deepfake: gigantes da tec 'armam' combate a mídias manipuladas

Sem tempo, irmão

- Uma nova onda de conteúdo distorcido promete comprometer a confiança de informação online

- São as deepfakes, fotos, vídeos e áudios distorcidos que, de tão realistas, podem enganar facilmente

- Usuários e as empresas de tecnologia têm dificuldade para diferenciar conteúdo real do editado

- Facebook, Microsoft e universidades dos EUA se uniram para contornar o problema

- A rede social vai investir até US$ 10 milhões para criar ferramentas 'caça deepfake'

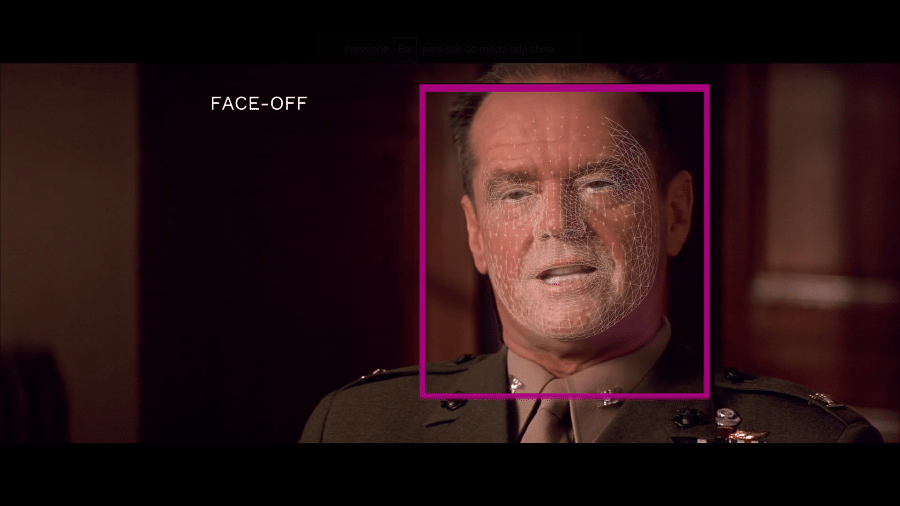

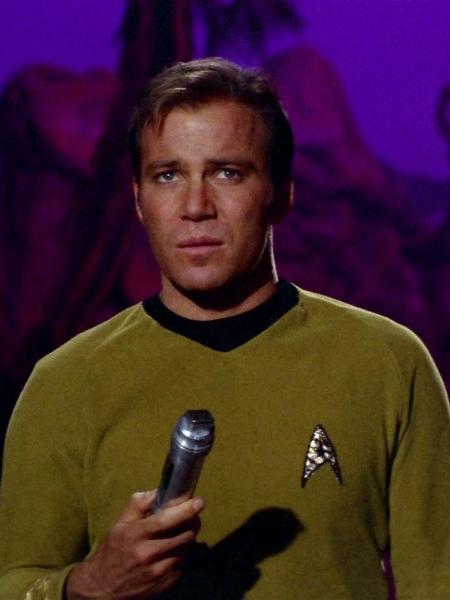

Imagine a situação: você recebe um vídeo em que uma personalidade faz algo controverso. É o rosto da pessoa, mas ela nunca esteve nessa situação. O que aconteceu? Se você se indignou com o que viu, saiba que acabou de ser vítima de uma "deepfake", as fotos, vídeos ou áudios manipulados que viraram a nova ameaça online à confiança das informações na internet.

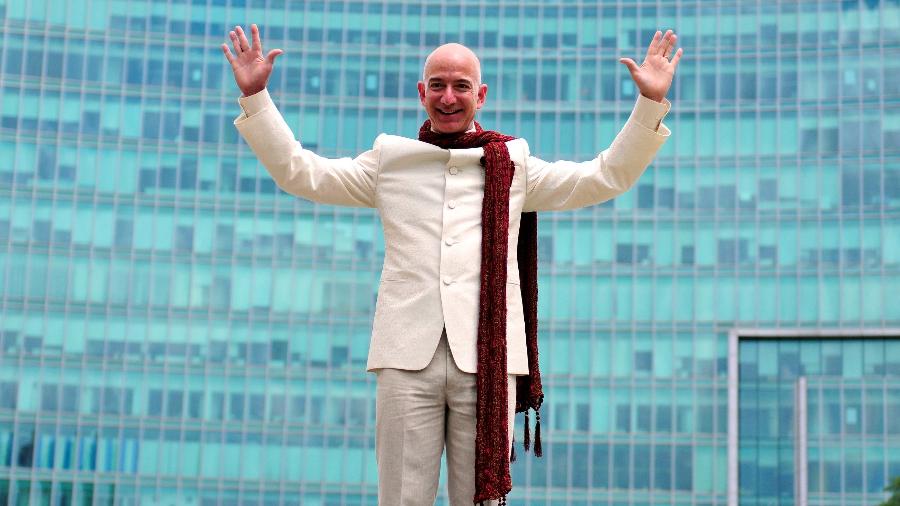

Não pense, no entanto, que só você tem problemas para diferenciar conteúdos reais dos editados. Mesmo com todos os bilhões investidos em pesquisa e dispondo dos melhores profissionais, as gigantes de tecnologia sofrem para diferenciar uma coisa da outra. Para combater o problema, Facebook e Microsoft se uniram a diversas universidades dos Estados Unidos, como MIT e Oxford, para incentivar a criação de ferramentas que ajudem a detectar deepfakes. A iniciativa, lançada nesta quinta-feira (5), receberá só da rede social investimento de US$ 10 milhões.

A manipulação virou pop

Se antes a elaboração de deepfakes convincentes era algo que exigia o conhecimento de técnicas complexas de inteligência artificial, agora a manipulação está ao alcance de qualquer um com um smartphone. Nesta semana, um app chinês chamado Zao virou um hit por permitir exatamente isso: colocar rostos em quaisquer cenas -- e de forma bastante realista. A coisa começou como brincadeira, mas ficou séria: o WeChat, espécie de WhatsApp chinês, chegou a bloquear a página para o serviço por considerá-lo perigoso.

As pessoas manipulam imagens praticamente desde que a fotografia existe. Mas agora é possível para quase qualquer um criar e passar conteúdos falsos para um público de massa

Antonio Torralba, professor de Engenharia Elétrica e Ciência da Computação e diretor do MIT

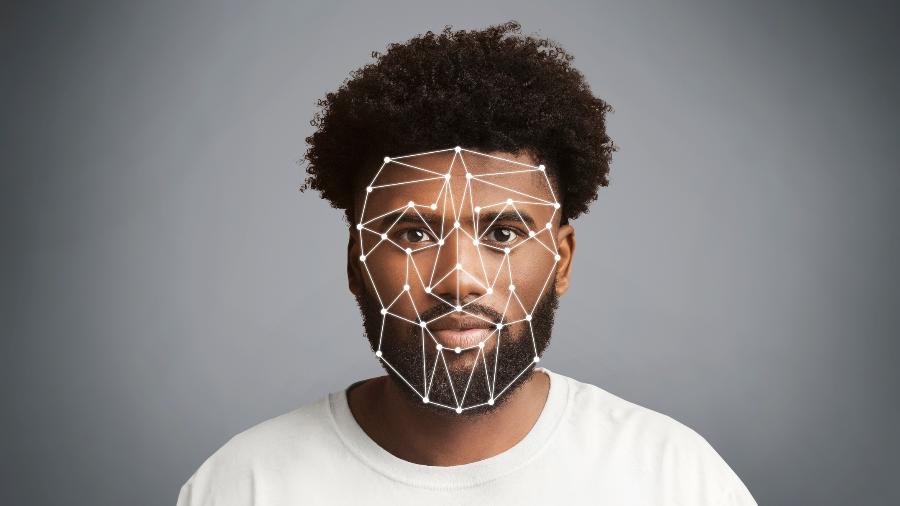

Qual é o problema em achar uma deepfake?

A principal dificuldade das empresas de tecnologia é que seus sistemas de inteligência artificial simplesmente não conseguem reconhecer se algo é modificado. Na verdade, eles não foram treinados para olhar um vídeo ou uma foto e duvidar de sua autenticidade. O que eles aprenderam foi identificar o que está nessas imagens.

O vice-presidente de tecnologia do Facebook, Mike Schroepfer, explica que essas plataformas só evoluíram porque tiveram à disposição bancos de dados para treinar. O ImageNet reúne quase 15 milhões de imagens e é usado para o reconhecimento de objetos, animais, plantas e pessoas. Já o Glue e o SuperGlue são conjuntos de áudios para que os sistemas inteligentes treinem sua capacidade de entender como as pessoas falam.

Segundo Schroepfer, o mundo da tecnologia não possui um banco de imagens para ensinar seus robôs a reconhecer deepfakes.

A tecnologia para manipular imagens está avançando mais rápido do que nossa capacidade de dizer o que é real e o que foi manipulado.

Phillip Isola, professor assistente de Engenharia Elétrica e Ciência da Computação do MIT

Não quer dizer que seja impossível identificar fotos e vídeos manipulados, mas isso exige perícia técnica grande o suficiente para ser impraticável caso haja uma enxurrada de deepfakes.

"A mídia manipulada colocada na internet para criar teorias da conspiração e manipular as pessoas está se tornando um tema de importância global. Acredito que precisamos urgentemente de novas ferramentas para detectar e caracterizar essa desinformação", afirmou Philip HS Torr, professor do Departamento de Ciência da Engenharia, Universidade de Oxford.

Para solucionar o problema, empresas e universidades se juntaram. Participam, por exemplo, acadêmicos da Cornell Tech, MIT, Oxford, UC Berkeley, Universidade de Maryland em College Park e Universidade de Albany-SUNY.

O grupo vai trabalhar em diversas frentes. Uma delas será analisar um conjunto de imagens e classificá-las como falsas ou verdadeiras. Nesse sentido, o Facebook irá contratar um banco de dados para colocar à disposição dos pesquisadores.

Diante dos escândalos recentes de privacidade em que se viu envolvida, a empresa fez questão de afirmar que não haverá nesse banco de dados nenhuma informação de seus usuários, mas, sim, dados de pessoas que consentiram em compartilhá-los com esse objetivo e foram pagas para isso. A outra frente de atuação será o financiamento de pesquisas, que contará com US$ 10 milhões do Facebook.

As descobertas iniciais serão testadas na Conferência Internacional sobre Visão Computacional, a ser realizada em outubro deste ano. Todo o projeto é supervisionado pela Partnership on AI, uma organização que conta com outras empresas de tecnologia, como Google e Apple, entidades da academia e veículos de mídia, como BBC e New York Times.

Os pesquisadores envolvidos admitem que o problema não é fácil de resolver. Mas afirmam que a união entre academia e indústria de tecnologia é um passo importante — ainda que seja o primeiro de uma longa caminhada.

Para passar da era da informação para a era do conhecimento, devemos melhorar a distinção do real e do falso, recompensar conteúdo confiável sobre conteúdo não confiável e educar a próxima geração em esforços de pesquisa da indústria, universidade e ONGs para desenvolver e operacionalizar tecnologia que pode distinguir com rapidez e precisão qual conteúdo é autêntico

Hany Farid, professor no Departamento de Engenharia Elétrica e Ciência da Computação e na Escola da Informação, UC Berkeley

SIGA TILT NAS REDES SOCIAIS

- Twitter: https://twitter.com/tilt_uol

- Instagram: https://www.instagram.com/tilt_uol/

- WhatsApp: https://uol.page.link/V1gDd

- Grupo no Facebook Deu Tilt: https://www.facebook.com/groups/2554025421295388

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.