DALL-E virou febre nas redes. Mas como uma IA cria imagens tão perfeitas?

Sem tempo, irmão

- Inteligência artificial já consegue criar imagens realistas a partir de descrições simples em texto

- Versões de código aberto permitem que qualquer um crie imagens com a ajuda de um robô

- No entanto, a tecnologia ainda tem falhas, permite criar fake news e cai em estereótipos

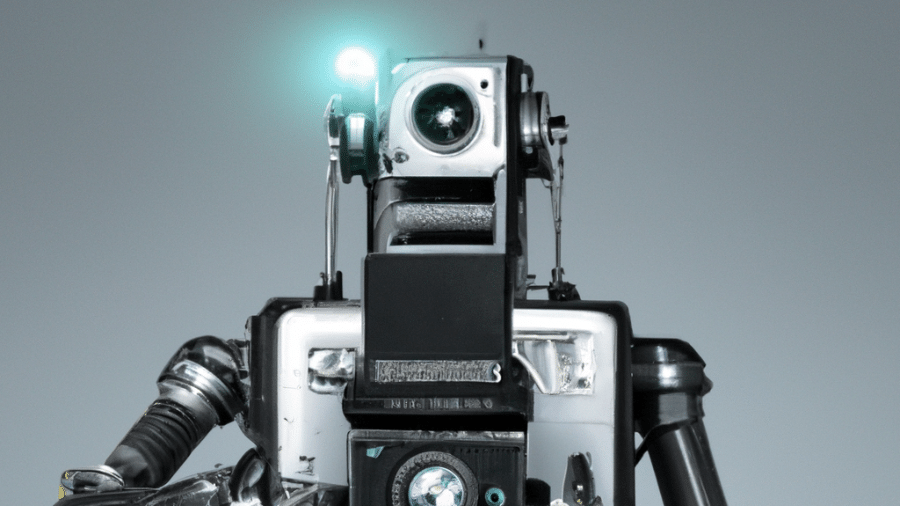

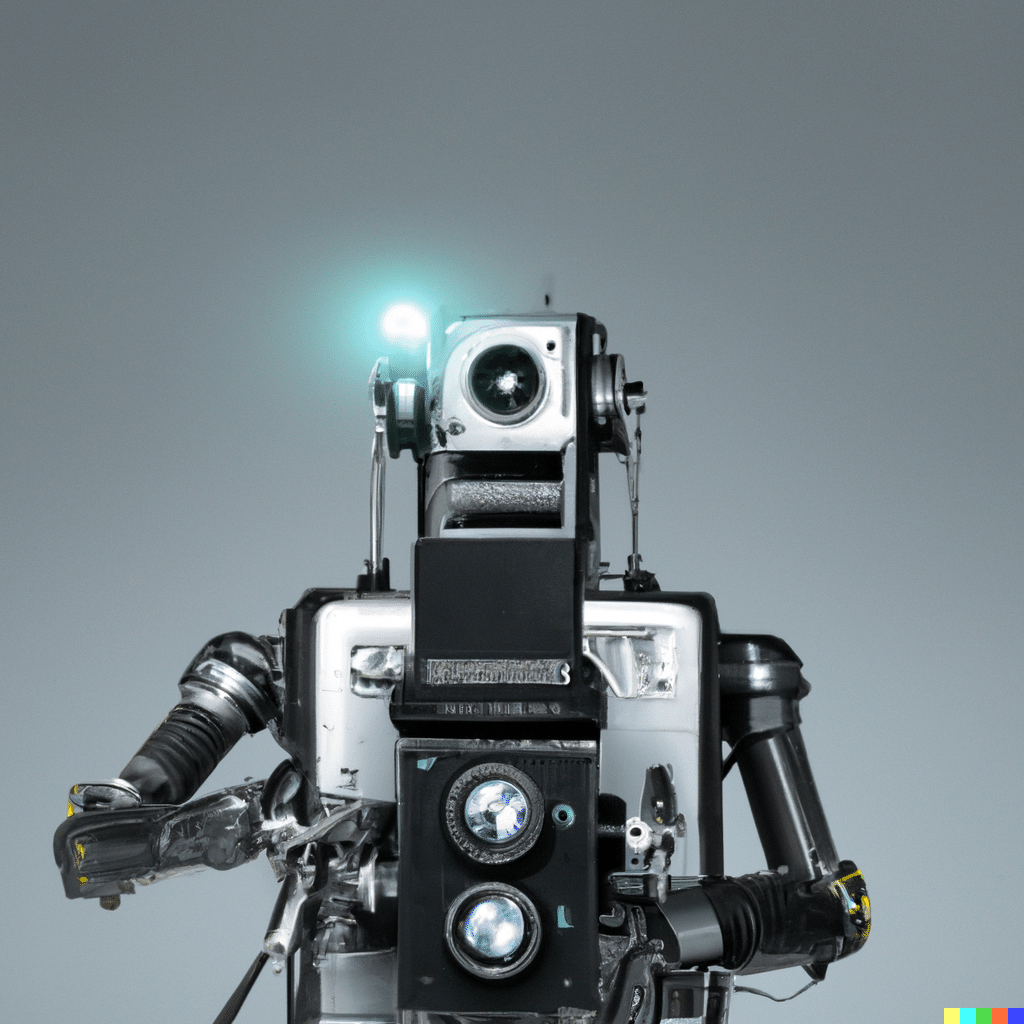

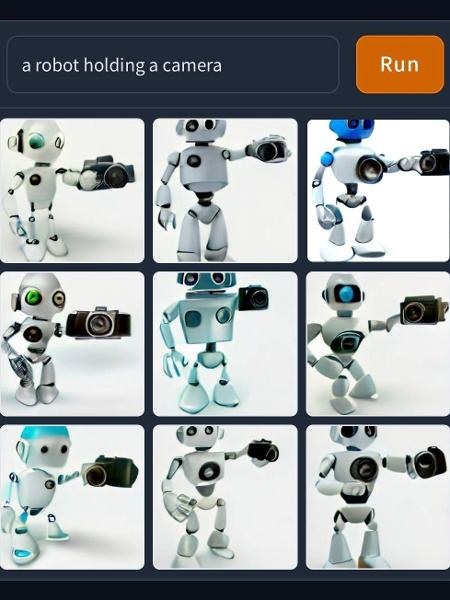

A imagem que você vê na abertura desta reportagem foi criada por uma inteligência artificial. E não foi preciso usar códigos ou ter qualquer conhecimento de machine learning (método de treinamento de algoritmos) para criá-la. Bastou uma simples descrição em texto: "um robô segurando uma câmera".

Este "autorretrato" foi gerado pelo DALL-E 2, um modelo de ML criado pela OpenAI, uma empresa de pesquisa em inteligência artificial bancada por Elon Musk. A companhia também é criadora de alguns dos modelos de IA mais avançados do mundo, como o GPT-3, que gera conversas naturais em texto e é usado para chatbots.

Apresentada em abril deste ano, o DALL-E 2 (pronuncia-se "Dalí", como o pintor espanhol Salvador Dalí) é a segunda versão dessa inteligência artificial capaz de criar qualquer imagem a partir de descrições em linguagem natural. A primeira foi lançada em 2021, mas não viralizou tanto quanto a nova.

O motivo é o nível de realismo da nova versão. Poucas semanas após a revelação do DALL-E 2, redes sociais foram tomadas por imagens impressionantes criadas com descrições simples. Não demorou para que mais empresas quisessem entrar na onda. Em maio, o Google anunciou seu concorrente: o Imagen.

Mas modelos de IA capazes de criar imagens não são novidade. Desenvolvedores independentes vêm explorando a ideia há anos. Apps como o Dream, da Wombo, fazem de graça.

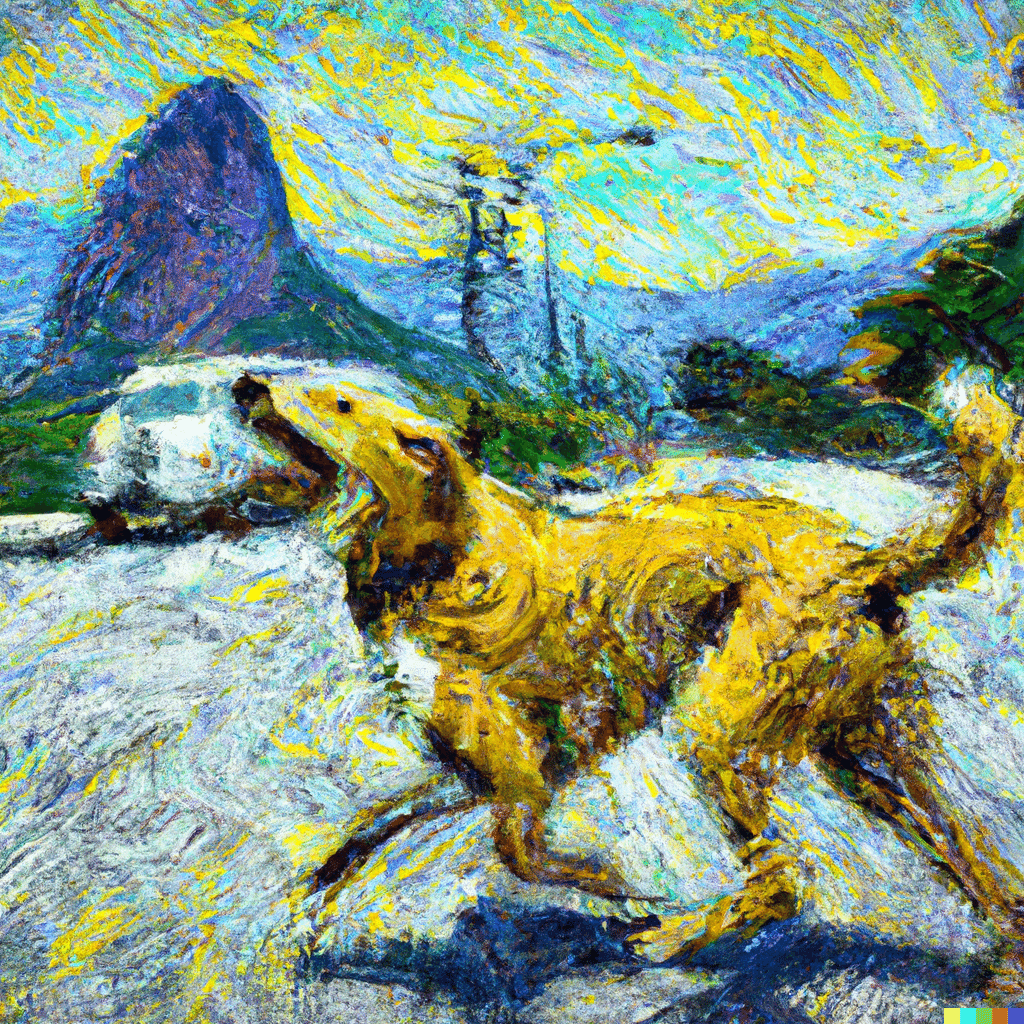

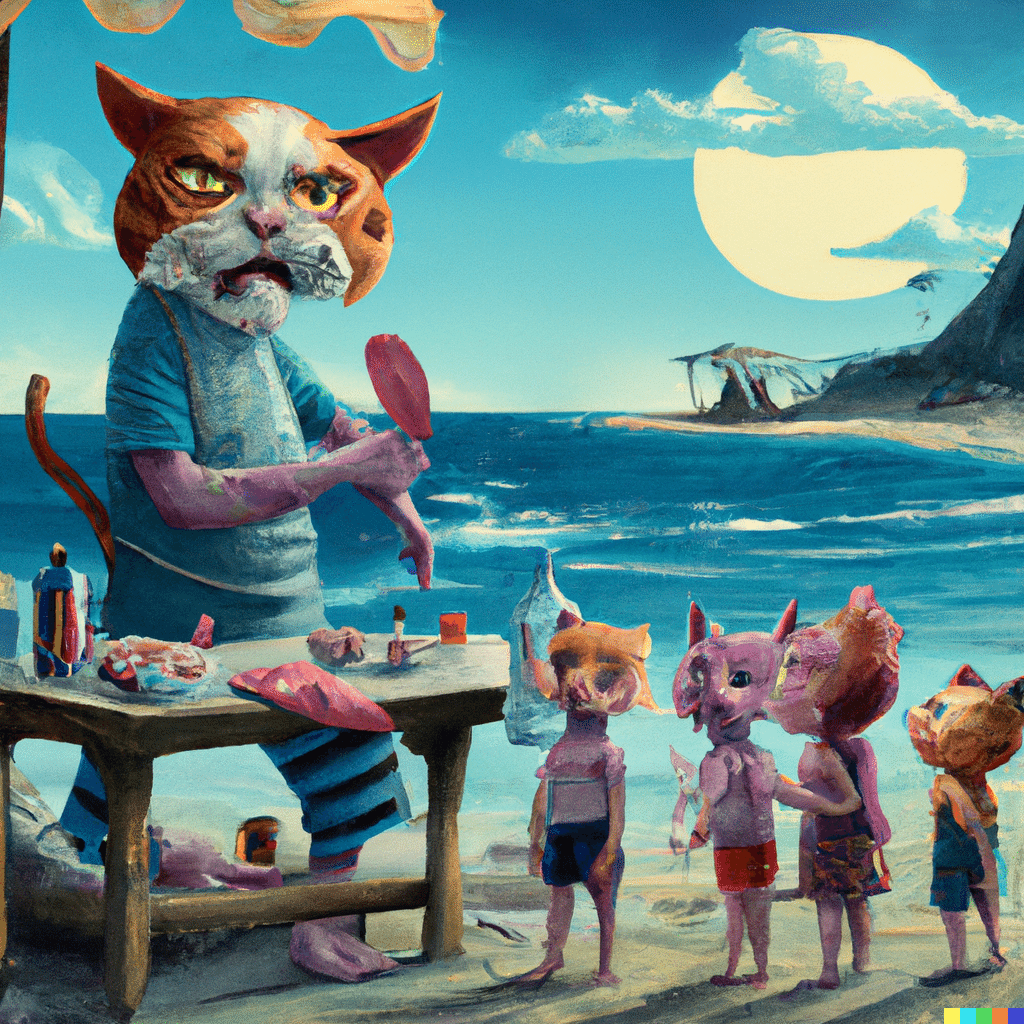

Nos últimos dias, o DALL-E mini virou febre nas redes sociais, gerando imagens estranhas, engraçadas e aleatórias. Ele também é uma versão aberta, hoespedada na plataforma colaborativa Hugging Face, bem menos potente que o DALL-E 2 —mas também com muito menos restrições.

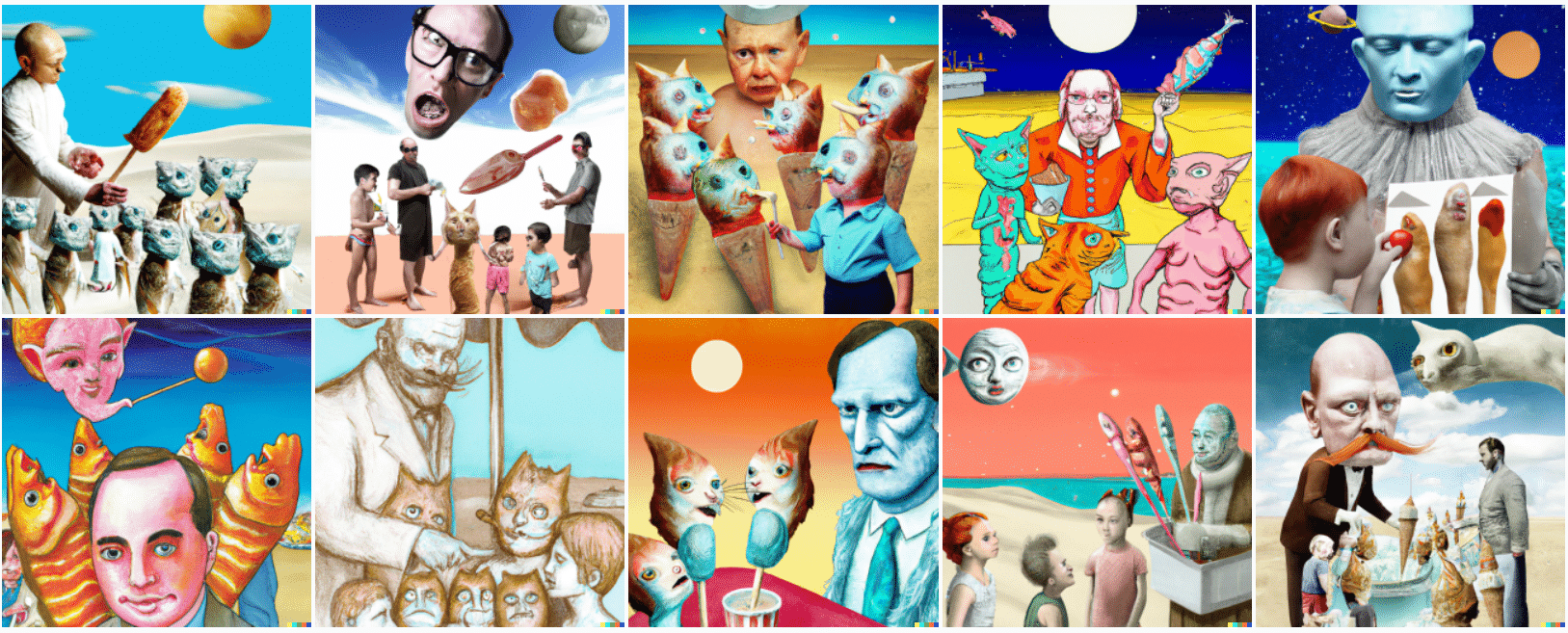

Imagens criadas pelo DALL-E 2

Como funciona?

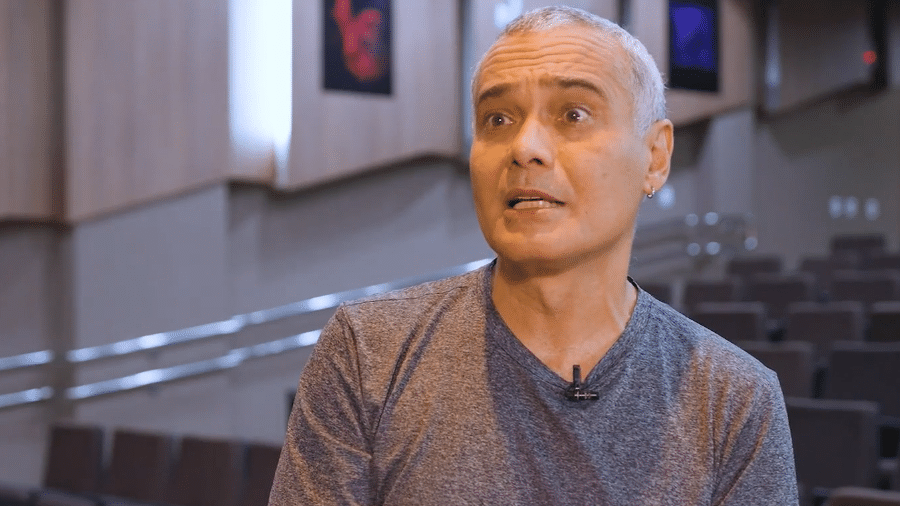

"Normalmente, estamos acostumados a usar IA para identificar e entender coisas. Aqui temos o que chamamos de IA generativa: ela cria coisas novas, e não só entende o que já existe", explica Yuri Malheiros, professor Universidade Federal da Paraíba e coordenador do ARIA, Laboratório de Aplicações em Inteligência Artificial da UFPB. "Isso é muito impressionante."

DALL-E 2 e Imagen partem do mesmo princípio de qualquer modelo de machine learning: o algoritmo processa um volume imenso de dados e é treinado para identificar padrões entre eles. Neste caso, os dados são imagens e descrições em texto.

A segunda etapa é a geração do conteúdo: por meio de um processo chamado de "difusão", o robô consegue juntar todas as imagens de cavalo que ele já viu, misturá-las e, em seguida, destacar as partes em comum para criar uma imagem nova em alta resolução.

Além de criar imagens, a IA também consegue gerar variações de uma imagem já feita. Tilt teve um breve acesso ao DALL-E 2 completo (que ainda é fechado para convidados da OpenAI) e pedimos que ela gerasse variações de uma foto deste repórter que assina a reportagem. O resultado:

Versões abertas

Enquanto a OpenAI e Google mantêm o acesso à sua ferramenta restrito a pesquisadores, o DALL-E mini está fazendo a festa com o público leigo.

Essa espécie de "cópia" do DALL-E em código aberto foi criada por Boris Dayma, um desenvolvedor francês casado com uma brasileira e ex-estudante da Pontifícia Universidade Católica do Rio de Janeiro (PUC-Rio).

"O primeiro DALL-E é mais ou menos parecido com o nosso [DALL-E mini]", diz Boris, que fala português, em entrevista a Tilt.

Qualquer pessoa pode gerar imagens com descrições em inglês no site do DALL-E mini. Para imagens mais artísticas, os resultados são comparáveis aos dos modelos da OpenAI, exceto pela resolução menor. Em imagens mais fotorrealistas, porém, a diferença entre uma empresa bancada pelo homem mais rico do mundo e um app feito por voluntários fica mais clara.

"O DALL-E 2 tem uma coisa muito diferente que é a difusão. Com essa arquitetura, ele é mais lento, mas chega a um resultado muito mais impressionante", reconhece Dayma.

Mesmo sabendo que haveria limitações na capacidade do "mini", o desenvolvedor achou importante levar a ferramenta às pessoas.

"O desafio tecnológico [de recriá-la] era muito interessante, mas eu também queria dar acesso ao público a uma versão que qualquer um pudesse usar", diz. "Muitas vezes você vê artigos que falam de novidades de IA, mas há muitas novidades que não são necessariamente reais, ou que têm limites. Quando você tem uma demo, um aplicativo, você pode brincar, tocar e ver de verdade como ela é."

Para Clem Delangue, presidente-executivo da Hugging Face, que hospeda essa versão, alternativas de código aberto como essa permitem que a tecnologia evolua de forma mais justa, com livre acesso de estudantes e pesquisadores, e impedem que a inovação seja monopolizada por Big Techs.

"Se você olhar para qualquer tecnologia e qualquer ciência, sempre houve essas duas abordagens, aberta e fechada", diz Delangue, em entrevista a Tilt. "São abordagens complementares. Mas a beleza do open source é a mesma beleza da ciência: fazer coisas de forma aberta, transparente, colaborativa. É poder distribuir o poder para que qualquer organização possa se manter atualizada e garantir proteções éticas para que a tecnologia possa evoluir."

ID: {{comments.info.id}}

URL: {{comments.info.url}}

Ocorreu um erro ao carregar os comentários.

Por favor, tente novamente mais tarde.

{{comments.total}} Comentário

{{comments.total}} Comentários

Seja o primeiro a comentar

Essa discussão está encerrada

Não é possivel enviar novos comentários.

Essa área é exclusiva para você, assinante, ler e comentar.

Só assinantes do UOL podem comentar

Ainda não é assinante? Assine já.

Se você já é assinante do UOL, faça seu login.

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Reserve um tempo para ler as Regras de Uso para comentários.