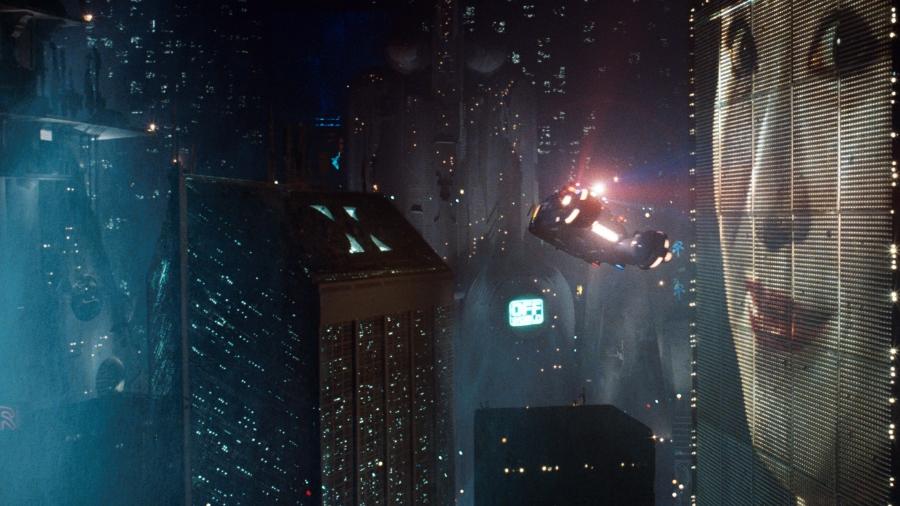

'Singularidade': a inteligência artificial vai sair de nosso controle?

Na física, uma singularidade é um ponto no espaço-tempo em que ocorre um evento que não está em conformidade com nenhuma das leis físicas esperadas para ele.

Na computação, uma “singularidade” seria um evento no qual os sistemas não só não se comportam conforme o esperado, mas subitamente fornecem uma resposta inesperada com base em um critério próprio.

Nesse ponto, qualquer previsão do que acontecerá em seguida falharia. E quando os seres humanos não conseguem nem mesmo controlar imaginativamente os possíveis cenários futuros, eles começam a se preocupar.

Alertas

Para alguns, isso não está muito longe de acontecer. Por exemplo, o cientista da computação e futurista Ray Kuzweil, em uma entrevista em 2023, afirmou que a singularidade começaria em 2045.

Enquanto isso, pesquisadores de prestígio como Geoffrey Hinton, Yoshua Bengio ou Stuart Russell aparecem na mídia alertando-nos sobre um emergente grave perigo. Até mesmo um dos fundadores da OpenAI, Sam Altman, chegou ao ponto de pedir a um comitê do Senado dos EUA que regulasse os avanços da inteligência artificial (IA). O cenário é realmente tão preocupante assim?

Consciência nas máquinas

A chave para essa preocupação não está tanto na singularidade, mas no primeiro passo em direção a ela: a criação de uma nova inteligência artificial geral, ou generalista (AGI, na sigla em inglês).

Estamos nos referindo a uma inteligência capaz de se igualar à inteligência humana nos processos cognitivos e relacionais, ou seja, uma IA capaz de dominar as oito inteligências múltiplas.

Se alcançada, essa seria a terceira grande revolução na história da IA. Tanto é assim que há uma corrida geopolítica silenciosa para ver quem será o primeiro a chegar lá.

Inteligência artificial com intenção?

Embora os sistemas de IA atuais, de acordo com alguns, possam mostrar sinais de alguma autoconsciência - como Blake Lemoine publicou em suas “conversas” com LamDa ou da Microsoft por meio de uma publicação - as IAs atuais não “sabem” ou não estão “conscientes” do que estão gerando.

Elas são apenas boas preditoras de pixels ou palavras, com base nos itens acima, mas sempre com base em treinamento. Eles não podem “refletir” sobre se essas inferências estão corretas, nem são capazes de levantar hipóteses sobre os motivos de suas próprias conclusões.

Portanto, também não têm consciência de seu posicionamento subjetivo diante delas. Estes sistemas são simplesmente muito bons em dar respostas, mas não são capazes de desenvolver as perguntas certas. Por enquanto…

A chave: imitar o cérebro humano

A primeira revolução no mundo da IA veio com a implementação simplificada, in silico, do modelo de um neurônio natural. Em 1906, Frank Rosenblatt projetou o “perceptron”, a base de todas as redes neurais artificiais atuais.

Newsletter

Um boletim com as novidades e lançamentos da semana e um papo sobre novas tecnologias. Toda sexta.

Quero receberA segunda revolução na IA veio, mais uma vez, com a “cópia” de uma topologia de rede neural humana em um programa. Desta vez, foi Kunihiko Fukushima que, em 1980, inspirado pelo modelo proposto pelos ganhadores do Prêmio Nobel Hubel e Wiesel (1959), desenvolveu a base das atuais redes convolucionais e profundas.

Foi o nascimento de uma revolução tecnológica sem precedentes, aprimorada progressivamente pelos cientistas da computação Jan LeCun e Dan Ciresan.

Hoje, dentro da neurocomputação, uma segunda versão muito promissora dessas redes, chamada redes neurais de impulso ou spiking, está sendo desenvolvida.

Para chegarmos a uma IA generalista - ou AGI - devemos andar de mãos dadas com a neurocomputação, pesquisando a topologia de uma rede artificial capaz de gerar regras matemáticas, semânticas ou linguísticas formais, formulando hipóteses sobre as respostas obtidas pela IA tradicional. Mas o nível atual de computação já atingiu seu limite para esse objetivo.

O próprio Moore previu que, até 2021, uma nova tecnologia substituiria seu modelo atual de crescimento computacional. E ele estava certo.

Essa tecnologia é a computação quântica. Com apenas 40 qubits, podemos processar por “força bruta” e em paralelo tantos estados computacionais quanto o número de neurônios em nosso cérebro.

Além disso, certas teorias indicam que, não apenas no nível atômico, mas também no nível cerebral, há um comportamento quântico na inferência e na comunicação entre neurônios em áreas não adjacentes.

O ganhador do Prêmio Nobel de Física Roger Penrose é um dos principais defensores dessa teoria, que é complementada por outras abordagens, como a teoria de Kauffman ou a teoria de Bleck e Eccles.

Os primeiros sinais da singularidade?

Já existem abordagens iniciais para a AGI reflexiva, como os sistemas MuZero ou LIDA. Os principais centros de pesquisa, como o I3B (Ibermática Fundazioa), passaram anos pesquisando o desenvolvimento da AGI com base na inclusão de uma topologia de gráfico semântico em sistemas profundos.

Isso envolve reunir os mundos da neurocomputação, da computação quântica e da inteligência artificial em um trabalho multidisciplinar entre neurocientistas, humanistas, antropólogos, engenheiros, cientistas da computação, cientistas de dados e programadores quânticos.

Nesse contexto, uma nova AGI exigiria necessariamente a implementação da autoconsciência artificial. O país que conseguir isso liderará uma quarta revolução tecnológica, consolidando um setor incrivelmente lucrativo que o posicionará como fornecedor global. A Espanha tem muitos recursos e talentos em IA, quântica e neurocomputação para conseguir isso.

Por outro lado, será o nascimento de novos sistemas capazes de nos ajudar a entender melhor nosso Universo e a nós mesmos, propondo perguntas que, talvez, nunca tenhamos feito a nós mesmos.

Então, certamente, teremos alcançado uma nova singularidade. Nossa própria busca pelo progresso científico nos levará a ela.![]()

Aitor Moreno Fdz. de Leceta, Profesor de Computación Cuántica, Inteligencia Artificial, Universidad de Deusto

This article is republished from The Conversation under a Creative Commons license. Read the original article.

Deixe seu comentário

O autor da mensagem, e não o UOL, é o responsável pelo comentário. Leia as Regras de Uso do UOL.